常温液态奶作为一个已经诞生出现两大全国性巨头的成熟行业股票正规配资公司,在过去10年间,已经很少有新的进入者。

*ST吉药表示,孙军已于2022年6月8日从公司离职,王德恒已于2019年10月29日从公司离职。

编辑:编辑部 HYZ

【新智元导读】喜大普奔!就在刚刚,加州州长宣布:否决加州AI限制法案。LeCun李飞飞吴恩达激动地奔走相告,额手称庆。而强烈支持法案的Bengio和Hinton则对此保持沉默。OpenAI、谷歌、Meta纷纷逃过大劫。

重磅!

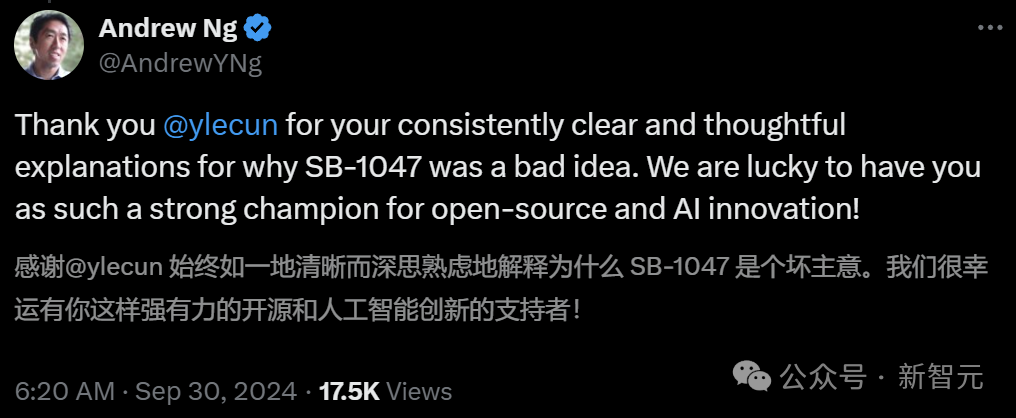

今天凌晨,美加州州长Gavin Newsom正式宣告:否决SB-1047法案!

对于全世界开发者们来说,SB-1047法案取消,意味着Meta、谷歌等大厂的开源模型,再次继续可用。

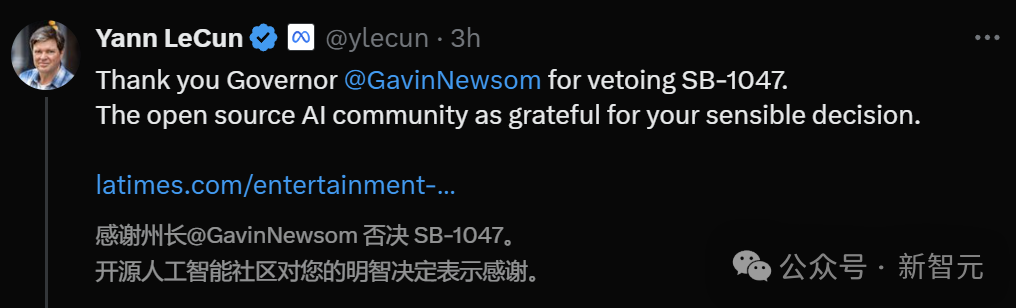

这个决定可谓是众望所归。AI圈大佬们激动地奔走相告,在否决中出了大力的吴恩达、LeCun、李飞飞,则尤其开心。

加州州长否决意味着什么?

SB-1047法案就真的终结了。

「臭名昭著」的SB-1047规定,SB 1047将会通过追究开发者的责任,来防止AI系统造成大规模人员伤亡,或引发损失超过5亿美元的网络安全事件。

消息一出,就引来学界和业界巨大的反对声浪。

要知道,全球50家顶尖GenAI企业,有32家便扎根在加州,它们在定义AI未来起着关键作用。

加州办公室新闻稿中介绍,过去一个月里,Gavin签署了18个GenAI法案,却唯独否决了SB-1047。

在过去30天里,州长签署了一系列法案,以打击Deepfake内容,以及保护表演者的数字肖像权等等

这项法案初衷是好的,但实际上存在一些严重的问题。

他表示,我认为这不是保护公众免受AI带来真正威胁的最佳方法。

SB-1047没有考虑到AI系统是否部署在高风险环境中、是否涉及关键决策,或敏感数据使用。相反,法案对最基本的功能——部署大模型系统,也应用了严格的标准。

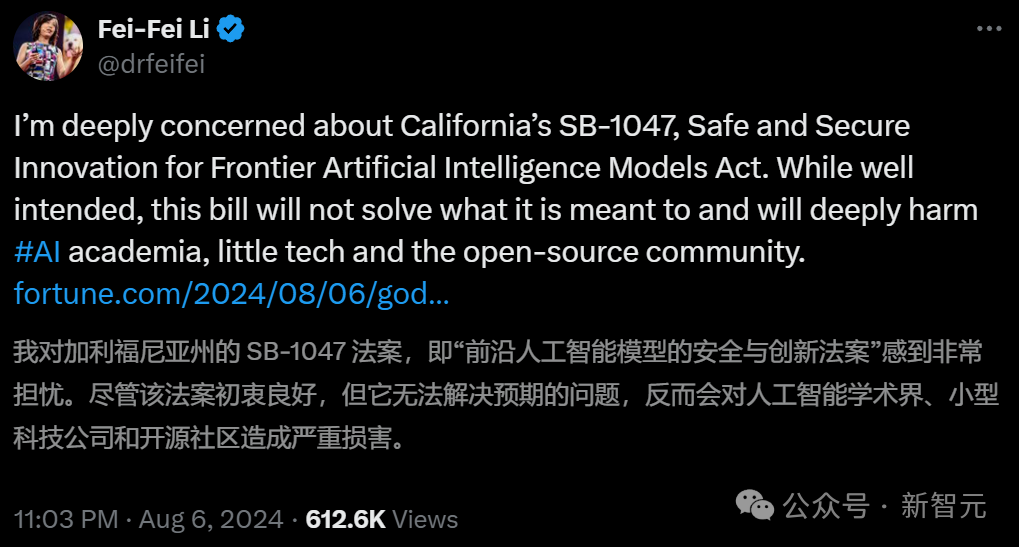

在SB-1047被否决的过程中,AI教母李飞飞起到的作用不容忽视。

斯坦福教授李飞飞开心地表示,自己能和StanfordHAI一起,为加州负责任的AI治理铺平道路,深感荣幸。

AI泰斗吴恩达也感谢了李飞飞对于SB-1047的公开反对,称她的努力能推动更理性的AI政策,从而保护研究和创新。

就在前几天,SB-1047法案即将尘埃落定之际,吴恩达和LeCun还在焦急地奔走呼吁、发起投票,担心一旦通过,开源AI和整个AI生态系统都会产生寒蝉效应。

如今,全加州的AI公司们终于松了一口气。

州长否决信:不予签署

「本人谨此退回参议院法案1047,不予签署。」

在信中,州长承认,SB-1047对于AI部署可能带来的威胁过于放大了。

而且,法案仅关注最昂贵的大规模模型,其实是给了公众一种「错误的安全感」。

他指出,即使是较小的专有模型,可能也会一样危险。

总之,法案对AI实施的监管,是以「遏制利于公众利益的创新」为代价的。

州长表示,法案对最基本的功能,也适用最严格的标准,这并不是保护公众买免受AI技术威胁的最佳办法。

而最好的解决办法是,是一个不以AI系统和能力的实证发展轨迹分析为依据的方案。

AI大佬深恶痛绝

这样的结局,对于除了Bengio、Hinton的绝大多数人,都可谓非常圆满。

提到SB-1047,一众大佬们是深恶痛绝。

事情的来龙去脉是这样的。

去年,加州州长签署了一项行政命令,强调加州面对GenAI态度要更加审慎,让AI更加道德、透明、可信。

而今年2月,加州直接拟定了法案,名为《SB-1047前沿AI大模型安全创新法案》,对于大模型安全、透明的使用给出了更具体的条例。

然而,其中有多项不合理内容,简直是指名道姓地给某些公司卡脖子。

成本超1亿的模型,得防止造成「重大伤害」

比如有一条规定,开发、训练成本超1亿美元,且浮点运算超过10^26次的大模型,一旦开源后被有人用来做非法的事,那么模型开发商也会受到严重处罚。

要知道,Meta的Llama 3模型,谷歌的Gemma模型等,都符合这个条件。

这个规定显然极有争议。

比如,如果有人入侵自动驾驶系统并导致事故,开发该系统的公司也要被追责吗?

按照法案的说法,开发者需要评估其模型的衍生产品、防止他们可能造成的任何伤害,包括客户微调模型、以其他方式修改模型(越狱)或与其他软件组合。

然而一旦开源软件发布,人们可以直接将模型下载到个人设备上,因此开发者根本无从得知其他开发者或客户的具体操作。

另外,法案中也有多处定义模糊。

比如AI模型的「关键伤害」,被描述为大量伤亡、超过5亿美元的损失或其他「同等严重」的伤害,但开发者在什么条件下要被追责?要承担何种责任?

法案对此都语焉不详。

并且,法案适用于花费超过1亿美元训练的AI模型,或花费超过1000万美元微调现有模型的开发者,也就让许多小型科技公司落入被打击范围。

SB-1047还有一些不合理规定,比如如果公司开放模型给其他国家使用,还得提交客户的所有资料,包括客户的身份证、信用卡号、账号等。

开发者还必须创建能够解决AI模型风险的测试程序,并且必须每年聘请第三方审计员来评估其AI安全实践。

对于那些基于模型打造的AI产品,则需要制定相应的安全协议来防止滥用,包括一个关闭整个AI模型的「紧急停止」按钮。

法案被诟病:对真正的风险视而不见

更多批评者认为,这个法案实在是过于杞人忧天了。

它不仅会阻碍AI的创新,而且对当今AI的安全性也没有帮助。

更讽刺的是,法案用所谓的「紧急开关」预防世界末日,但对Deepfake、虚假信息等已出现的安全风险却视而不见。

虽然后来的修正案在措辞上更加宽松,减少了加州政府追究AI实验室责任的权力。

但即便如此,SB-1047也会给OpenAI、Meta、谷歌等大厂带来不小的影响。

而对一些初创企业来说,这种打击甚至会是毁灭性的。

如今尘埃落地,大公司和小初创们都可以长出一口气了。

图灵巨头决裂

SB-1047,甚至让图灵三巨头为此「决裂」。

LeCun、李飞飞、吴恩达为代表的大佬们,多次公开反对不满。

甚至,LeCun还照搬了之前要求暂停AI研究时的原梗——请暂停AI立法六个月!

而图灵三巨头中的另外两位——Yoshua Bengio和Geoffrey Hinton,却出人意料地强烈支持这项法案通过。

甚至还觉得,现在的条款定得有些太过宽松了。

作为高级人工智能技术和政策研究人员,我们写信表达对加州参议院法案1047的强烈支持。

SB 1047概述了对这种技术进行有效监管的基本要求。它没有实施许可制度,不要求公司在训练或部署模型之前获得政府机构的许可,它依赖于公司自行评估风险,甚至在发生灾难时也不对公司严格追责。

相对于我们面临的风险规模,这是一项相对宽松的立法。

取消该法案的基本措施将是一个历史性的错误——这一错误将在一年内变得更加明显,因为下一代更强大的AI系统将被发布。

但Bengio和Hinton显然不是主流。

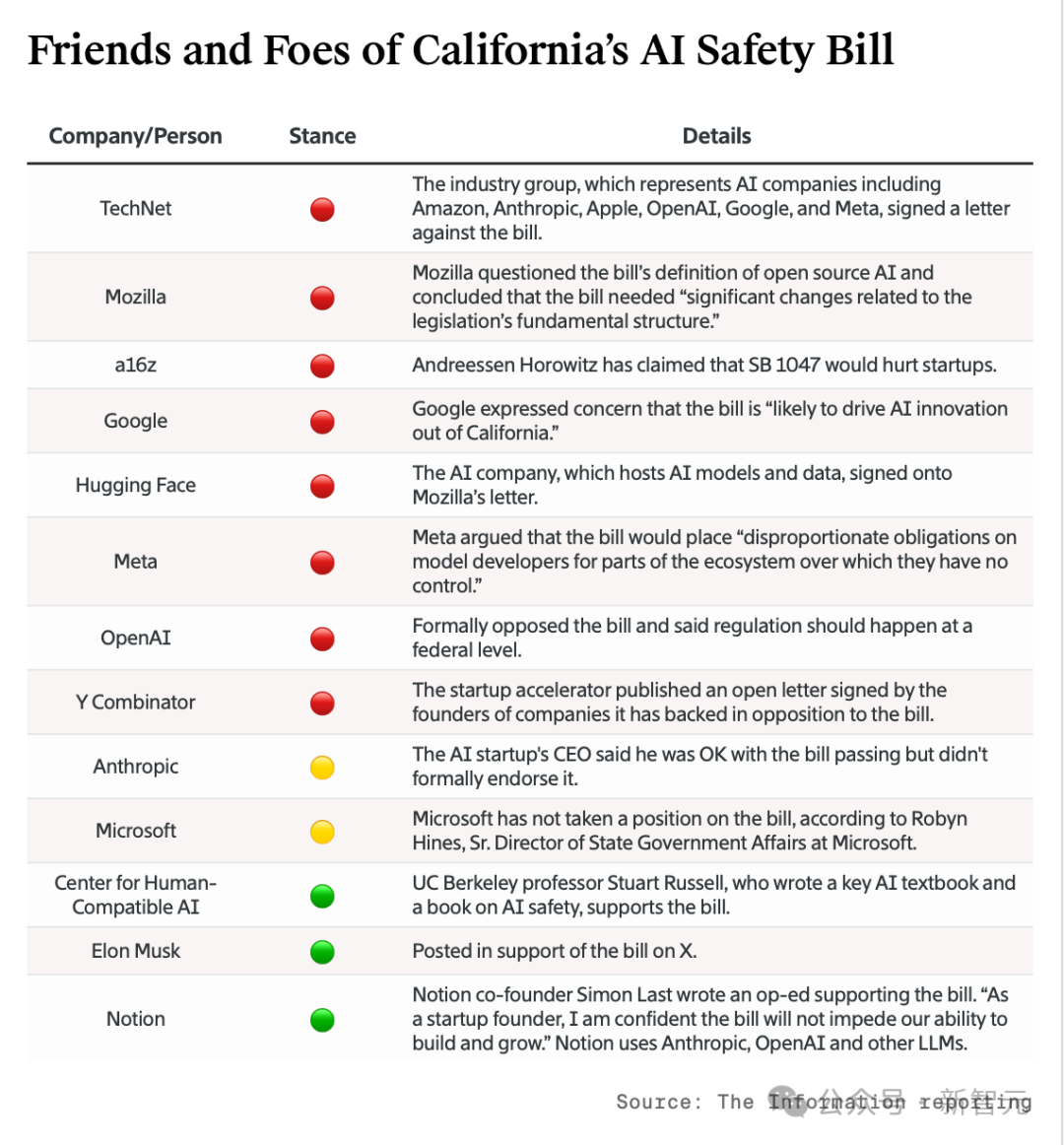

总结来说,各家科技巨头和一众大佬对此的立场如下。